Die gängige Weisheit lautet: „Wenn Sie nicht möchten, dass Ihre Daten verwendet werden, melden Sie sich von allem ab.“

Wir sagen: „Wenn Ihre Daten ohnehin erfasst werden, ist es sinnvoller, Einfluss darauf zu nehmen, wie sie verwendet werden.“

Es geht nicht um die Frage: „Sollten Unternehmen meine Daten haben?“ (Die haben sie bereits).

Die eigentliche Frage lautet: „Sollten meine Daten dazu beitragen, eine bessere KI für alle zu entwickeln?“

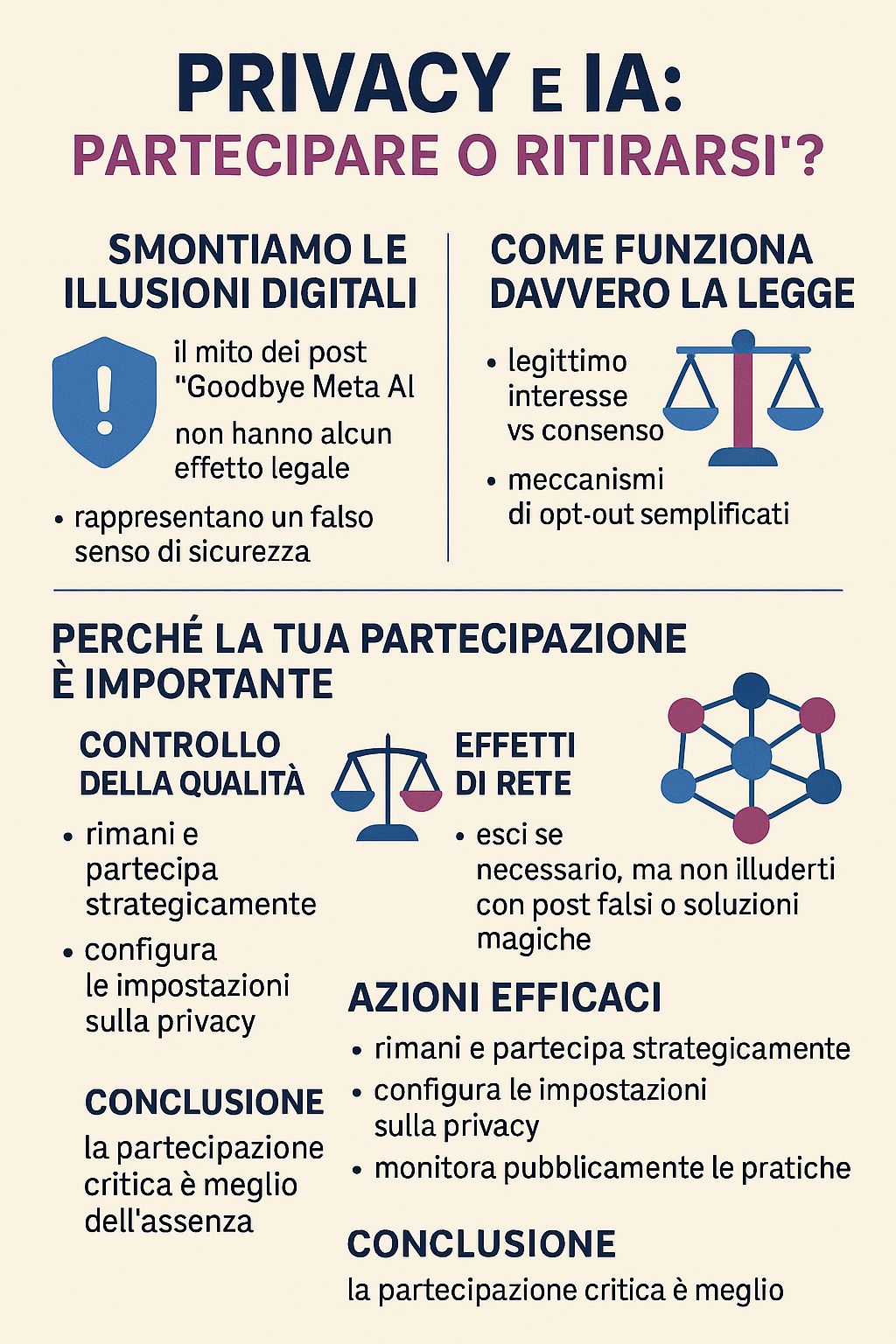

Bevor wir eine ernsthafte Argumentation aufbauen, müssen wir zunächst eine gefährliche Illusion entlarven, die in den sozialen Medien kursiert: die viralen Posts „Goodbye Meta AI“, die versprechen, Ihre Daten zu schützen, indem Sie einfach eine Nachricht teilen.

Die unbequeme Wahrheit: Diese Beiträge sind komplett gefälscht und können Sie angreifbarer machen.

Wie Meta selbst erklärt, „stellt das Teilen der Nachricht ‚Goodbye Meta AI‘ keine gültige Form des Widerspruchs dar“. Diese Beiträge:

Der virale Erfolg dieser Beiträge offenbart ein tiefer liegendes Problem: Wir bevorzugen einfache und illusorische Lösungen gegenüber komplexen und fundierten Entscheidungen. Das Teilen eines Beitrags gibt uns das Gefühl, aktiv zu sein, ohne dass wir uns die Mühe machen müssen, wirklich zu verstehen, wie unsere digitalen Rechte funktionieren.

Aber Privatsphäre lässt sich nicht mit Memes verteidigen. Sie lässt sich nur mit Wissen und bewusstem Handeln verteidigen.

Seit dem 31. Mai 2025 hat Meta eine neue Regelung für das Training von KI eingeführt, die sich rechtlich auf das „berechtigte Interesse” statt auf die Einwilligung stützt. Dabei handelt es sich nicht um eine Gesetzeslücke, sondern um ein in der DSGVO vorgesehenes Rechtsinstrument.

Das berechtigte Interesse ermöglicht es Unternehmen, Daten ohne ausdrückliche Zustimmung zu verarbeiten, wenn sie nachweisen können, dass ihr Interesse nicht die Rechte des Nutzers überwiegt. Dies schafft eine Grauzone, in der Unternehmen durch interne Bewertungen „das Gesetz nach Maß schneiden”.

Die Verwendung nicht anonymisierter Daten birgt „ein hohes Risiko für Modellumkehrungen, Speicherlecks und Extraktionsschwachstellen“. Aufgrund der erforderlichen Rechenleistung können nur Akteure mit sehr hohen Kapazitäten diese Daten effektiv nutzen, was zu systemischen Asymmetrien zwischen Bürgern und großen Unternehmen führt.

Nachdem wir nun die rechtlichen und technischen Aspekte geklärt haben, wollen wir das Argument für eine strategische Beteiligung aufbauen.

Wenn bewusste Menschen aufgeben, trainiert die KI an denen, die übrig bleiben. Möchten Sie, dass KI-Systeme hauptsächlich auf Daten von Menschen basieren, die:

Voreingenommenheit in der KI tritt auf, wenn die Trainingsdaten nicht repräsentativ sind. Ihre Teilnahme trägt dazu bei, Folgendes sicherzustellen:

KI-Systeme verbessern sich mit zunehmender Größe und Vielfalt:

Wenn Sie KI-basierte Funktionen (Suche, Übersetzung, Empfehlungen, Barrierefreiheits-Tools) nutzen, tragen Sie dazu bei, diese für alle zu verbessern, einschließlich zukünftiger Nutzer, die sie am dringendsten benötigen.

Ihre Privatsphäre ändert sich nicht wesentlich zwischen Opt-in und Opt-out für KI. Dieselben Daten werden bereits verwendet für:

Der Unterschied besteht darin, ob diese Daten auch zur Verbesserung der KI für alle beitragen oder nur den unmittelbaren kommerziellen Interessen der Plattform dienen.

Genau aus diesem Grund sollten verantwortungsbewusste Menschen wie Sie sich beteiligen. Sich zurückzuziehen, stoppt nicht die Entwicklung der KI, sondern nimmt Ihnen lediglich Ihre Stimme in dieser Debatte.

KI-Systeme werden auf jeden Fall entwickelt werden. Die Frage ist nur: mit oder ohne den Beitrag von Menschen, die sich kritisch mit diesen Themen auseinandersetzen?

Verständlich. Aber bedenken Sie Folgendes: Würden Sie es vorziehen, wenn KI-Systeme mit oder ohne den Beitrag von Menschen entwickelt würden, die Ihre Skepsis gegenüber großen Konzernen teilen?

Genau wegen deiner Skepsis ist deine kritische Beteiligung so wertvoll.

Künstliche Intelligenz wird Realität, ob Sie daran teilnehmen oder nicht.

Ihre Entscheidung betrifft nicht, ob KI entwickelt wird, sondern ob die entwickelte KI die Werte und Perspektiven der Menschen widerspiegelt, die sich intensiv mit diesen Themen auseinandersetzen.

Ein Opt-out ist wie Nichtwählen. Es verhindert nicht die Wahlen, sondern bedeutet lediglich, dass das Ergebnis Ihren Beitrag nicht berücksichtigt.

In einer Welt, in der nur Akteure mit extrem hoher Rechenleistung diese Daten interpretieren und effektiv nutzen können, kann Ihre kritische Stimme beim Training mehr Einfluss haben als Ihre Abwesenheit.

Bleiben Sie und beteiligen Sie sich strategisch, wenn:

Und in der Zwischenzeit:

Aber mach dir keine Illusionen mit:

Dein individueller Verzicht hat nur minimale Auswirkungen auf deine Privatsphäre, aber dein Verbleiben hat reale Auswirkungen auf alle.

In einer Welt, in der KI-Systeme den Informationsfluss, Entscheidungen und Interaktionen zwischen Menschen und Technologie bestimmen werden, geht es nicht darum, ob diese Systeme existieren sollten, sondern ob sie die Sichtweise von reflektierten und kritischen Menschen wie Ihnen berücksichtigen sollten.

Manchmal ist es nicht die radikalste Maßnahme, aufzugeben. Oft ist es die radikalste Maßnahme, zu bleiben und dafür zu sorgen, dass die eigene Stimme gehört wird.

Anonym

Es geht nicht darum, Unternehmen blind zu vertrauen oder Datenschutzbedenken zu ignorieren. Es geht darum zu erkennen, dass Datenschutz nicht mit Memes verteidigt wird, sondern durch strategisches und bewusstes Engagement.

In einem Ökosystem, in dem die Machtasymmetrien enorm sind, kann Ihre kritische Stimme bei der KI-Ausbildung mehr Wirkung haben als Ihre protestierende Abwesenheit.

Wie auch immer deine Entscheidung ausfällt, triff sie bewusst und nicht aufgrund digitaler Illusionen.

Ein Absatz der Sympathie auch für die „Einsiedler der Privatsphäre“ – jene reinen Seelen, die glauben, sich vollständig der digitalen Verfolgung entziehen zu können, indem sie wie tibetische Mönche des Jahres 2025 offline leben.

Spoiler: Selbst wenn Sie in einer abgelegenen Hütte in den Dolomiten leben, sind Ihre Daten bereits überall zu finden. Ihr Hausarzt nutzt digitale Systeme. Die Bank, bei der Sie Ihre Ersparnisse für den Kauf von Brennholz anlegen, protokolliert jede Transaktion. Der Supermarkt im Dorf verfügt über Kameras und elektronische Zahlungssysteme. Selbst der Postbote, der Ihnen Ihre Rechnungen bringt, trägt zu Logistik-Datensätzen bei, die Optimierungsalgorithmen speisen.

Die vollständige digitale Abgeschiedenheit im Jahr 2025 bedeutet im Wesentlichen, sich selbst aus der Zivilgesellschaft auszuschließen. Man kann auf Instagram verzichten, aber man kann nicht auf das Gesundheits-, Bank-, Bildungs- oder Arbeitssystem verzichten, ohne dramatische Auswirkungen auf die Lebensqualität zu haben.

Und während du deine Anti-5G-Hütte baust, bleiben deine Daten weiterhin in den Datenbanken von Krankenhäusern, Banken, Versicherungen, Gemeinden und Finanzämtern gespeichert und werden weiterhin dazu verwendet, Systeme zu trainieren, die zukünftige Generationen beeinflussen werden.

Das Paradox des Einsiedlers: Deine protestierende Isolation verhindert nicht, dass KI-Systeme anhand der Daten weniger bewusster Menschen trainiert werden, sondern schließt dich von der Möglichkeit aus, ihre Entwicklung in ethischere Richtungen zu beeinflussen.

Im Wesentlichen hast du die unberührte moralische Reinheit dessen erobert, der die Geschichte von der Tribüne aus beobachtet, während andere – weniger aufgeklärt, aber präsenter – die Spielregeln schreiben.

Wie auch immer deine Entscheidung ausfällt, triff sie bewusst und nicht aufgrund digitaler Illusionen.

Zitierte Artikel:

Weitere Informationen zu DSGVO und berechtigtem Interesse:

Offizielle Quellen:

Konkrete Maßnahmen: Wenn Sie sich in Europa befinden, informieren Sie sich bei der Datenschutzbehörde über die offiziellen Opt-out-Verfahren. Allgemeine Informationen finden Sie in den Datenschutzeinstellungen und Nutzungsbedingungen Ihrer Plattform. Und denken Sie daran: Beiträge in sozialen Medien haben keine Rechtskraft.